AIの評価は「AI性能」ではなく「利用条件」で変わる

同じAIを使っていても、短セッション/小コンテキストと、長時間/巨大コンテキスト/反復検証では観測される挙動が変わります。

本ページは、SNS #30 の受けとして、入口(Free / Plus / Pro / Team / Enterprise / API)と、観測される現象を構造として固定します。

TL;DR

- ライトユーザー:短いセッション/小さなコンテキスト → 多くの問題が観測されにくい

- ヘビーユーザー:長時間/巨大コンテキスト/反復 → ループ/要約劣化/コンテキスト崩壊などが観測される

- 結論:AIの評価は モデル差だけでなく 利用条件(usage conditions)で変わる

- まず AI User Architecture(入口)を整理する

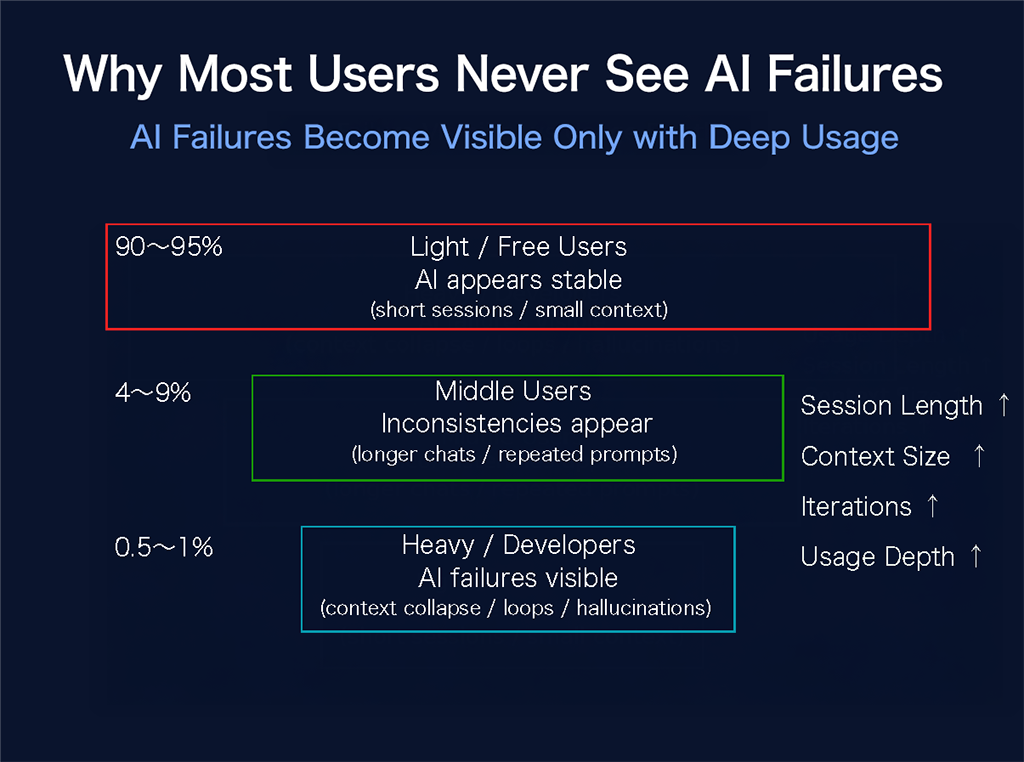

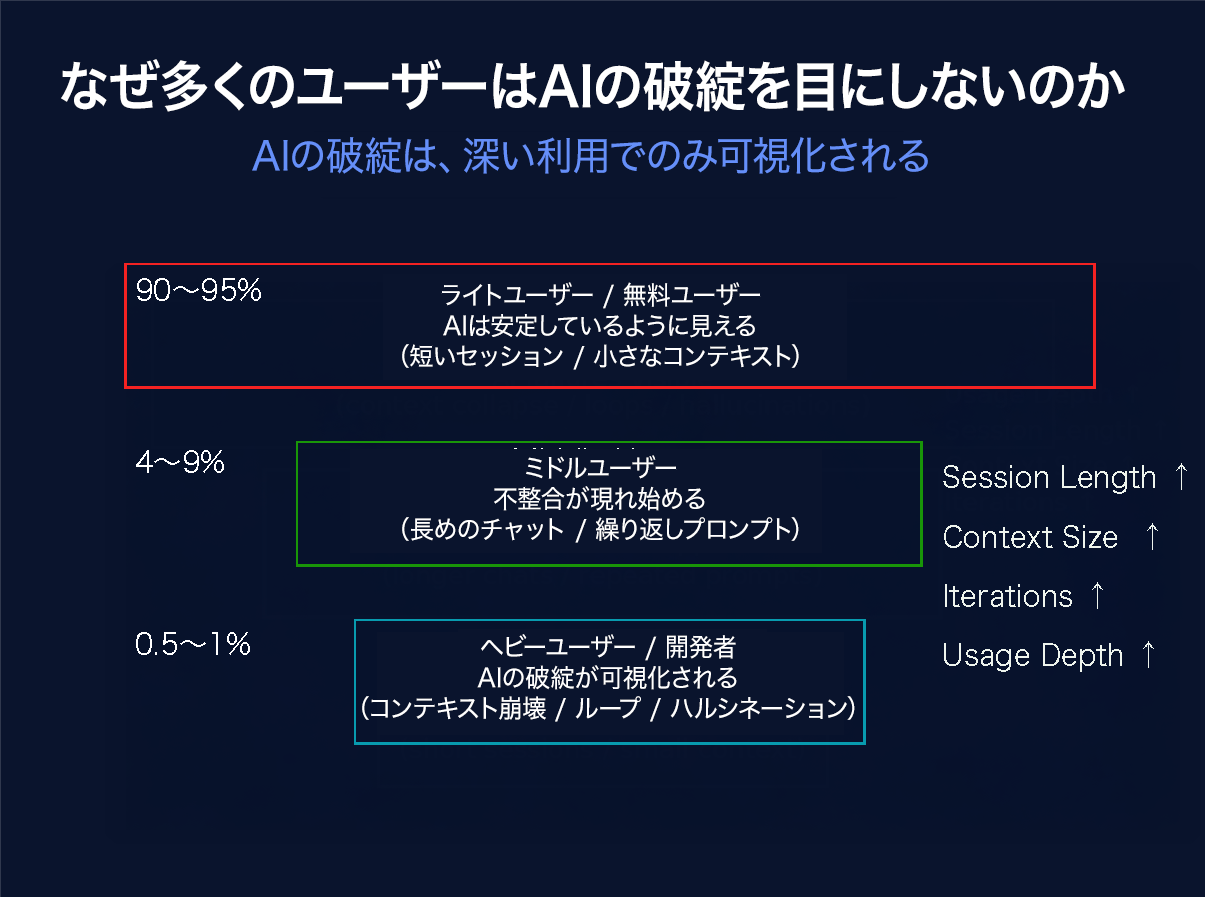

01 — Why Most Users Never See AI Failures

入口(Free / Paid / API)を整理すると、利用条件の差が見えるようになります。 ここでは ChatGPT / Gemini を同じ粒度で配置し、UI課金とAPI課金を分けます。

Why Most Users Never See AI Failures

なぜ多くのユーザーはAIの破綻を目にしないのか

Short sessions rarely expose problems.

Long sessions / repeated prompts increase the chance of observing structural issues.

Evaluation must consider the usage environment.

02 — 利用条件の差(Light vs Heavy)

AIの「使い方」を条件として分解すると、議論がズレにくくなります。 ここでは、現場でよく出る2クラス(ライト/ヘビー)を 条件セットとして固定します。

短セッション / 小コンテキスト

- 短いセッション

- 小さなコンテキスト

- 単発の質問・単発の回答

- 用途:翻訳 / 要約 / メール作成 / 検索

この条件では、ループや要約崩壊などは 出にくい。AIは「普通に便利」に見える。

長時間 / 巨大コンテキスト / 反復検証

- 長時間セッション

- 巨大コンテキスト

- 技術議論 / 構造検証 / コード生成

- 検証の反復(数十回〜)

条件が揃うと挙動が変わる:コンテキスト崩壊 / 回答ループ / 要約劣化 / ハルシネーション増加。

条件の見える化(比較軸)

Interface : UI / API

Session : short / long

Context size : small / large

Iteration : single / repeated

Work type : simple / technical

Observed : stable / loops / summary drift / context collapse

03 — AI User Distribution

AIユーザーは同じように見えて、実際には利用の深さに大きな差があります。 多くのユーザーはライト利用であり、長時間の反復作業を行うユーザーはごく少数です。

AI User Distribution

90–95% Light Users

Short sessions

Small context

Simple tasks

4–9% Middle Users

Moderate sessions

Mixed workloads

0.5–1% Heavy / Developers

Long sessions

Large context

Repeated iterations

AI failures are mostly observed by the smallest user group.

Long sessions, large context windows, and repeated iterations

increase the probability of observing structural issues.

04 — AI Access Architecture

AIの挙動は、まず「どの入口からアクセスしているか」で大きく変わります。 UI課金モデルとAPI課金モデルでは、セッション構造・制限・利用パターンが異なります。

AI Access Layer UI Access Free Plus Pro Team Enterprise API Access OpenAI API Gemini API Claude API

UI利用(Free / Plus / Pro / Team / Enterprise)は、人間との対話を前提とした利用形態であり、 文章作成、設計検討、コード生成などの思考プロセスを伴う作業に適しています。

実際の開発現場では、長いセッションの中で設計・検証・修正を繰り返すことが多く、 PlusやTeamなどの統合UI環境をチューニングして利用する方が効率的なケースも少なくありません。

一方、API利用は大量処理・自動処理・システム組み込みなどに適した利用形態です。 そのため実務では、

UI → 思考・設計・生成

API → 自動処理・システム実装

という役割分担でAIを活用するケースが多くなります。

05 — SNS #30 要点整理

AIの評価は「モデル性能」だけではなく、ユーザーの利用条件によって大きく変わる。

#30|AIの評価は「利用条件」で変わる 1. AIの評価はモデル性能だけでは決まらない AIの見え方は、ユーザーの利用条件によって大きく変わる。 2. 多くのユーザーはライト利用 ・短いセッション ・小さなコンテキスト ・単発の質問 主な用途 翻訳 / 要約 / メール作成 / 検索 この条件ではAIの問題はほとんど観測されない。 3. ヘビーユーザーでは挙動が変わる ・長時間セッション ・大きなコンテキスト ・コード生成 ・反復検証 この条件では コンテキスト崩壊 回答ループ 要約劣化 ハルシネーション などが発生する。 4. 結論 AIを理解するには ・インターフェース ・セッション長 ・コンテキストサイズ ・反復回数 といった利用条件を整理する必要がある。 入口が違えば 観測されるAIも 評価されるAIも 大きく変わる。

06 — SNS #30 English Version

English summary of the core idea for global sharing and citation.

#30 | AI Evaluation Depends on Usage Conditions 1. AI evaluation is not determined by model performance alone. What we observe depends on how AI is used. 2. Most users are light users. Typical usage: • short sessions • small context • single questions Common tasks: • translation • summarization • email writing • search Under these conditions, most AI failures are rarely observed. 3. Heavy usage changes AI behavior. • long sessions • large contexts • code generation • repeated validation In these environments, AI failures become visible: • context collapse • response loops • summarization degradation • hallucinations 4. Conclusion To understand AI, we must examine usage conditions: • interface • session length • context size • iteration depth Different entry points reveal different AI.

Different entry points reveal different AI.