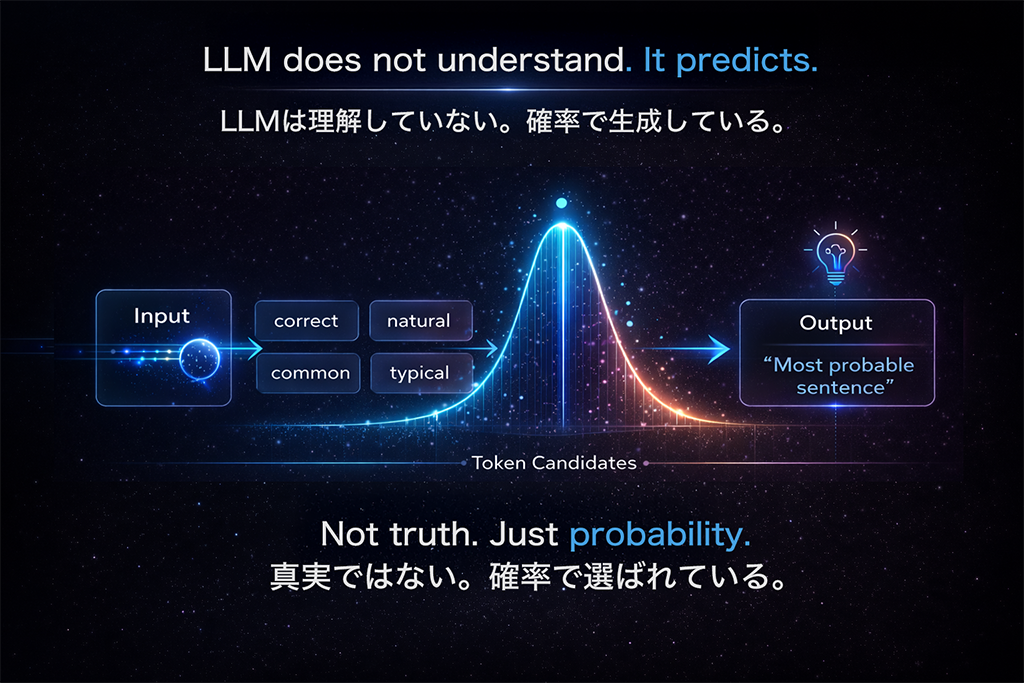

Key Visual

#35投稿と連動するキービジュアル。ここでは説明しすぎず、まず認識を揺らす。

確率に基づいて、自然に見える文章を生成している。

LLMは「正しいかどうか」を判断しているのではない。

確率に基づいて、最も自然に見える文章を計算して生成している。

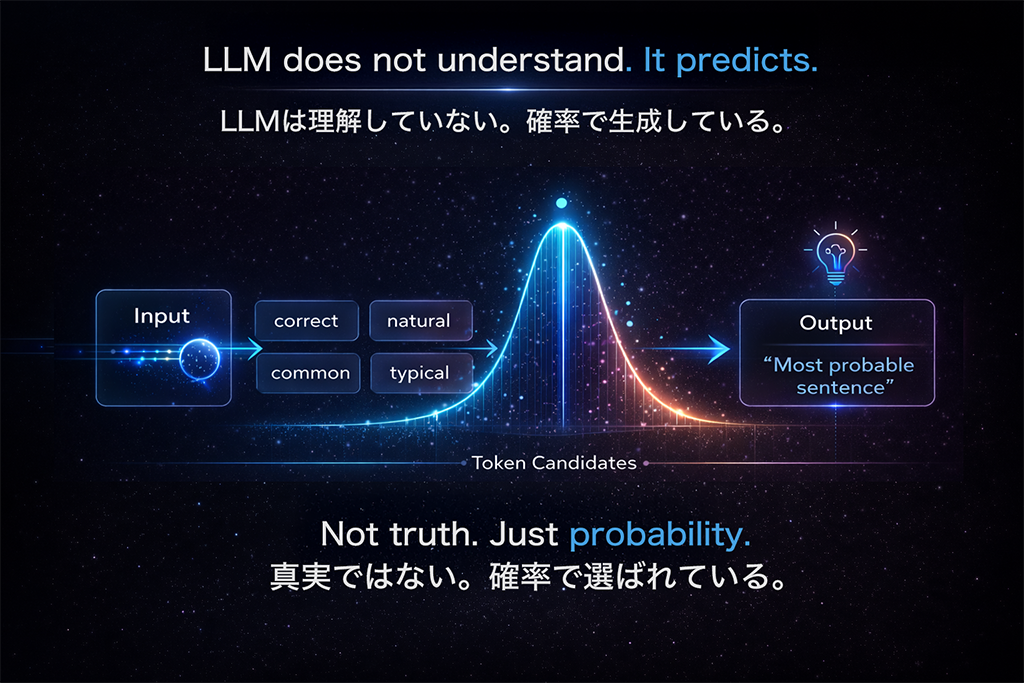

#35投稿と連動するキービジュアル。ここでは説明しすぎず、まず認識を揺らす。

AIが“賢く見える”理由と、その見え方が生む誤認を短く固定する。

私たちはAIを「賢い」と感じる。

しかし実際には、AIは意味や正しさを理解していない。

ただ膨大なデータの中から、

最もそれらしい言葉の並びを確率的に選んでいるだけである。

LLMは「意味理解マシン」ではなく、「次に来る語の確率を推定する生成器」として動く。

人がプロンプトを与える。業務文脈や曖昧さも、そのまま入力される。

文章を意味単位ではなく、トークン単位へ分解して内部処理に回す。

次に現れやすい語を確率分布として計算し、最も自然な候補群を選ぶ。

連続的に文章を出力する。ここに“正しさの保証機能”は標準では存在しない。

なぜ人は、AIの出力を「正しい」と錯覚しやすいのか。

人は、自然な文章を見ると、

そこに“理解”や“妥当性”があると感じやすい。

すぐ答えるAIに対して、

人は無意識に「迷っていない=正しい」と感じてしまう。

しかし、自然さと正しさは別物である。

ここを切り分けられないままAIを業務へ入れると、後工程で大きなコストになる。

現場では、AIの誤りは「不自然な誤り」ではなく、「自然に見える誤り」として現れる。

要件の一部だけを拾い、抜け落ちた前提を補完したつもりで文章化してしまう。

読む側は自然に見えるため、見逃しやすい。

一見動きそうなコードを出しても、例外処理・依存関係・環境差異・保守性まで担保しているとは限らない。

もっともらしい説明が並ぶと、会議・提案・レビューで“正しそうな方向”へ意思決定が流れてしまう。

AIは間違えないのではない。

自然に間違える。

必要なのは、AIへの過信ではなく、人間側の設計である。

精度の高いモデルを選ぶことだけでは不十分。

導入前提・比較方法・検証工程・責任分界まで含めて設計しなければならない。

初稿生成と最終判断を分離し、AIを“下書き担当”として位置づける。

1つのAIだけで決めず、出力差分や構造差分を観測できる状態を作る。

LLMが何をしていて、何をしていないのかをチームで共有する。

最終決定・承認・対外説明責任は必ず人間が持つ。

AIは、書く。

人は、決める。

生成AIを業務に入れるなら、この役割分担を曖昧にしてはいけない。

ここを明確にした組織だけが、AIを“便利な道具”ではなく“実務に耐える仕組み”へ変えられる。

本ページは AI構造シリーズの一部です。前後の流れとあわせて読むことで、理解がつながります。

前段の問題提起。#34から続く文脈を受け、AI理解のズレを整理する。

LLMは正しさを理解していない。

「AIは書く/人は決める」を固定する受けページ。

次章で、さらに業務導入・判断設計・実装観点へ接続していく。