AIをReactやPythonで「制御」しようとしていませんか。

現在、多くの開発現場では、

既存の決定論的なプログラミング手法でAIを扱おうとしています。

しかし、そのアプローチでは、

統合型LLMが持つ本来の推論能力を引き出すことはできません。

AIは関数ではない。

常に状態が変化し続ける「確率的なシステム」である。

本稿では、

なぜAIは制御できないのか、

そしてなぜ設計が必要なのかを整理します。

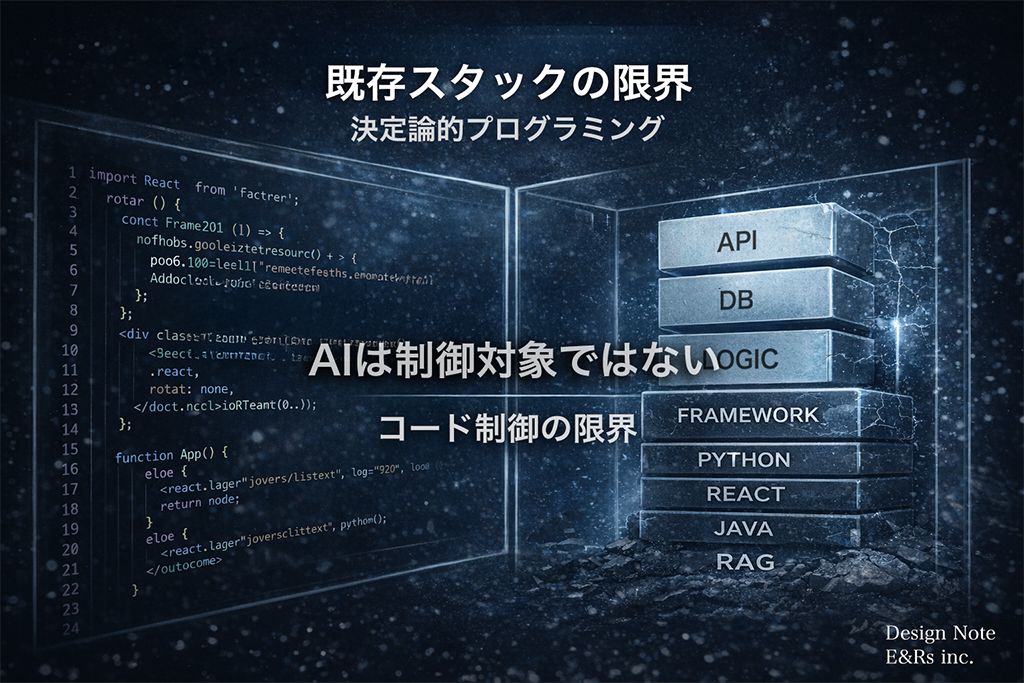

01|既存スタックの限界

React、Python、Javaといった既存言語は、

決定論的な処理を前提として設計されている。

しかしAIは、

その枠の中で完全に制御できる対象ではない。

API・DB・Logicといったレイヤーの上にAIを置くことで、

無理やり「制御可能な存在」として扱っている。

これは、

AIの推論能力を構造的に制限している状態である。

02|制御しようとするな

AIを制御しようとする発想そのものが誤りである。

AIは制御対象ではない。

共に動く対象である。

必要なのは制御ではなく、

状態を理解しながら扱う設計である。

03|制御は劣化を生む

AIは自由度の中で推論する。

それを制御することで、

推論の幅は制限される。

さらに問題なのは、

劣化が観測されないことである。

気づいた時には、

すでに壊れている。

04|壊れている場合

AIが壊れている場合、

構造はすでに「制御」状態にある。

つまり、

正常に見えている時点で、

すでに問題が進行している可能性がある。

05|制御しない設計

必要なのは制御ではない。

観測と判断である。

AIは止める、待つ、切り替える。

Monitor / Pause / Switch / Retry

これらを組み合わせることで、

不安定な知能を運用可能な状態に保つ。